@999js 必须要有里程计数据和充电桩信号

ROS Group 产品服务

Product Service 开源代码库

Github 官网

Official website 技术交流

Technological exchanges 激光雷达

LIDAR ROS教程

ROS Tourials 深度学习

Deep Learning 机器视觉

Computer Vision

frank 发布的帖子

-

Old version of cryptography ([1, 2, 3]) may cause slowdown警告解决办法发布在 技术交流

解决方法是更新软件

sudo pip install --upgrade cryptography sudo python -m easy_install --upgrade pyOpenSSL -

RE: google激光雷达slam算法Cartographer的安装及bag包demo测试发布在 产品服务

@山中客 虚拟内存指的是RAM运存,你的20g是硬盘容量,两者不是一个东西。 编译时,在指令后面加 -j 1 参数减小运存的消耗量

-

RE: BWDR03轮毂电机驱动器问题发布在 产品服务

@hqucyx 说明这个值不合适,同时电机极对数可能设置错了,比例、积分因子也可能不合适。速度最大值可以设大一些也不影响,设成100rpm时,下发5控制量对应的控制速度是5rpm即每秒0.083转,这是一个很慢的速度,对参数设置要求比较高。

-

RE: 为什么小强gmapping 建图清晰度不够?附图发布在 激光雷达

@山中客 这种安装反向和普通180度反向是不一样的,雷达旋转方向变了,逆时针和顺时针的区别。除了修改tf 还需要设置rplidar驱动launch文件中的inverted参数http://wiki.ros.org/rplidar

-

RE: 使用rosbag录制和回放3d激光雷达数据和小强ROS开发平台的里程计IMU数据发布在 激光雷达

@hanfighter1 https://pan.baidu.com/s/1rBWFRS90lB9_3_OTLUaCxA?errno=0&errmsg=Auth%20Login%20Sucess&&bduss=&ssnerror=0&traceid=

-

蓝鲸ROS轮毂无刷电机驱动器资料包发布在 产品服务

驱动器购买链接:https://item.taobao.com/item.htm?spm=a1z10.1-c.w4004-11026595866.2.1c75ea3d0RzxNp&id=559950579276

驱动器资料包: 链接:https://pan.baidu.com/s/10yifX8aZWVnZUdXW1g0gEw

提取码:15ef

驱动器对应的ROS驱动包手册在这篇帖子:https://community.bwbot.org/topic/2943/bw-dr03驱动器ros驱动包xqserial_server配置手册轮毂电机是一种轮子和电机相结合的新型电机。它被广泛应用于电动车,平衡车上面。由于其出色的运动性能和简易的机械安装结构,非常适合轮式机器人。

本驱动器支持12v到36v轮毂无刷电机,同时支持4路红外和2路超声波测距模块,带开源ROS驱动。基于本驱动器,可以快速搭建高速大载重ROS移动平台,支持ROS小强机器人开发教程。

简易测试视频在这个链接:https://www.bwbot.org/article/17

-

latency_timer值对usb转串口设备的卡顿、延时性能的影响发布在 技术交流

对于usb转串口设备,它硬件上一般有一个叫做latency_timer的定时器,当这个值设为lt时,表示数据会在设备上至少暂存lt 毫秒后再发送,只有在设备缓存写满的情况下才会忽略这个值而立即发送。latency_timer的取值范围一般为1到255之间,一般由设备驱动设置默认值。

ftdi芯片的串口设备,一般默认值会是16毫秒,这在高实时性的场景是无法忍受的,具体详情请阅读这篇帖子:https://projectgus.com/2011/10/notes-on-ftdi-latency-with-arduino/解决办法是:

1.手动设置latency_timer的值 # 先查看当前值 cat /sys/bus/usb-serial/devices/ttyUSB0/latency_timer #设置为最小值 1 ms sudo chmod 0666 /sys/bus/usb-serial/devices/ttyUSB0/latency_timer echo 1 > /sys/bus/usb-serial/devices/ttyUSB0/latency_timer #重启串口程序,应该就有效果了2.使用ioctl API代码的办法设置 #如果使用了boost asio库 #include <sys/ioctl.h> #include <linux/serial.h> boost::asio::basic_serial_port<boost::asio::serial_port_service>::native_type native = serial_port_.native(); // serial_port_ is the boost's serial port class. struct serial_struct serial; ioctl(native, TIOCGSERIAL, &serial); serial.flags |= ASYNC_LOW_LATENCY; // (0x2000) ioctl(native, TIOCSSERIAL, &serial); #不使用boost库,直接操纵设备的方式 #include <sys/ioctl.h> #include <linux/serial.h> // Open RS232 on COM1 mPhysicalComPort = open(aPort, O_RDWR | O_NOCTTY | O_NDELAY); struct serial_struct serial; ioctl(mPhysicalComPort, TIOCGSERIAL, &serial); serial.flags |= ASYNC_LOW_LATENCY; // (0x2000) ioctl(mPhysicalComPort, TIOCSSERIAL, &serial); -

deepmind 在nature发布自学习AlphaGo Zero发布在 行业动态

谷歌旗下人工智能公司DeepMind宣布AlphaGo出现了升级版AlphaGoZero,证实无监督强化学习在围棋这类问题中有state of art 级别的有效性。AlphaGo打败李世石用了3000万盘比赛作为训练数据,而AlphaGo Zero仅用了490万盘比赛数据。经过3天的训练,AlphaGo Zero以100:0的战绩完胜AlphaGo。

论文地址: https://deepmind.com/documents/119/agz_unformatted_nature.pdf

官方博客: https://deepmind.com/blog/alphago-zero-learning-scratch -

杭州宇树科技推出四足机器人LaiKago,对标波士顿动力Spot Mini发布在 行业动态

10月17日宇树科技发布了他们的四足机器人莱卡狗(Laikago),这是国内首个正式对外发布的四足机器人。

在足式机器人领域,创建于1992年的波士顿动力已经成了世界上最具影响力的机器人公司之一,在过去的25年一直保持研究的精神陆续研发出Petman、BigDog、Spot等双足或四足机器人,每一次都令业界振奋不已。而现在,国内也终于有企业做出了在性能上接近波士顿动力的足式机器人。

莱卡狗(Laikago)据宇树科技方面介绍,莱卡狗重量仅22kg,但其自行研发的电机系统能输出高达18千瓦的瞬时功率,算出来功率密度比一般的超级跑车还高将近一倍,这是莱卡狗强大动态性能的基础。另外莱卡狗也已经完全摆脱了外部供电,自带电池一次充电可以支持2~3小时的行走。

宇树科技还模仿波士顿动力拍摄了一段测试视频,视频中莱卡狗爬上了斜坡、穿过了石板路,以及再现了那个经典的被测试人员用脚踹的场景。当然,测试的结果是莱卡狗与波士顿动力的BigDog一样,稳定性表现的很优异。

当然,由于莱卡狗在外观上更像波士顿动力最新力作SpotMini,所以大家更喜欢将这两者放在一起做比较。雷锋网咨询了几位足式机器人方面的研究者,对于这款国产四足机器人,大家都给予了很高的评价,它的动作也基本都是模仿SpotMini做过的。从他们的评价中雷锋网(公众号:雷锋网)得出一个总结:莱卡狗在平稳性上与SpotMini的差距并不是很大,只不过SpotMini更加成熟,这一点体现在任务层面,SpotMini因为具备视觉系统可以完全自主执行任务,同时它的手臂也能让其完成抓取任务,而莱卡狗目前并不具备这些性能,简单说,它目前只是腿,SpotMini已经有手和眼睛了。

宇树科技是王兴兴去年8月成立的,在此之前他作为上海大学的一名学生因为做出一款小型电驱动四足机器人Xdog而被业内广泛关注过。

王兴兴向雷锋网表示,之所以给机器人取名莱卡狗(Laikago),是因为这是第一个太空狗的名字。创业之后王兴兴更多的是想把四足机器人商业化,而这是目前足式机器人面临的困境,波士顿动力在足式机器人领域的技术已经是世界前沿,不过经过了25年的研究,也始终没办法市场化,这也导致其被谷歌收购后又被转卖给软银。对此,王兴兴的想法是将机器人的成本降价,然后卖给高校、科技馆、科技竞赛以及科技爱好者,类似于一个新品种的航模。王兴兴向雷锋网透露莱卡狗的售价大概2~3万美金,分开发者版本和普通版本,开发者版本售价贵些。

当然,波士顿动力也没有停止想要将机器人商业化的想法,在三个月前RSS会议的一个workshop上,波士顿动力创始人兼CEO Marc Raibert也明确提出波士顿动力要进一步降低成本,推出消费级产品。

国内近年来在足式机器人领域也在努力追赶,如钢铁侠科技去年推出了双足大仿人机器人,上海交通大学对外展示了六足机器人,而在四足机器人方面,据雷锋网了解目前国内主要是山东大学、哈工大还有军方在研究。而就雷锋网所知,由浙江大学控制系机器人实验室出来的创业团队也在研发四足机器人,相信不久也会有新动态对外分享。

-

剖析谷歌ARCore:核心功能和与苹果ARKit的异同点发布在 行业动态

8月30日,谷歌突然重磅发布了属于安卓系统的AR SDK——ARCore,并号称将要安装到一亿台安卓设备上,目前三星S8和谷歌自家的手机Pixel已经都获得了支持。这一步,被普遍解读为对苹果六月份发布的ARKit的正面回应。

苹果在移动端AR上来势汹汹,ARKit一发布就刷了科技圈的屏,涌现出无数的开发者demo。相比之下,谷歌此前推出的需要TOF深度传感器使用的Tango平台,一下子似乎被拍死在了沙滩上,乏人问津。但如今,谷歌的ARCore不需要再仰仗TOF,而是和ARKit类似,直接使用手机的单目RGB摄像头,加上内部的IMU就能实现AR。这让不少人安卓开发者为之兴奋。

可以想象,两大移动互联网领域的超巨头在不远的未来,基于手机端AR必有一战。那么,ARCore底层技术的实现原理为何?是否有谷歌说得那么神?相比ARKit又有何异同和优劣势?

青亭网第一时间联系了专注于AR领域的源视感科技CEO周凡,他连夜阅读了ARCore的代码,并对谷歌放出的demo进行了逐帧分析。下面请看他带来的第一手报告:1

Apple的ARKit发布之后, 市场一片欢腾。经过一段时间的低潮后,对于AR的热情再一次被点燃。就在苹果沾沾自喜(我猜的)、安卓开发者表示强烈不满时(也是我猜的),谷歌昨天发布了Tango之后的单目+IMU增强现实方案——ARCore。

目的很明确,连名字都很霸气的相似——就是要怼ARKit去的。作为AR技术的先驱, 谷歌果然出手不凡,一次性在Github上放出三个SDK,涵盖安卓原生、Unity3D和Unreal平台。虽然没有像上次的SLAM方案Cartographer那样直接开源,但是对应用开发者,无论是手机端,还是嵌入式设备都算非常的友好了,貌似要一统开发者天下。

2

解密三大核心功能

连夜读了有限的代码,可以看出ARCore的核心功能有三个:相机姿态估计, 环境感知及光源感知(Light Estimation)。由于资料有限,只能做一个大概的估计与分析。

前两个功能,研究SFM、SLAM的同学应该不陌生了—— 前者通过单目相机读取图像,通过特征的匹配估计相机的运动轨迹。但是ARCore极有可能用的不是常见的特征匹配法。这里先卖个关子,下文再详细分析运动轨迹的估计方法。

至于环境感知功能,名字起的很高大上,但具体实现的功能其实就是检测平面。这样做的好处就是在现实环境中放置虚拟物体的时候位置相对合理,不会出现类似物体悬空,或者在斜面上仍然处于水平的姿态。

第三个光源感知功能,按照谷歌官方的说法是,ARCore能感知现实世界的光源位置,使虚拟物体能够形成相应方位的影子,从而增加虚拟物体在现实世界里的真实度。这个功能堪称惊艳!从谷歌发布的Demo视频里看, 虚拟物体的影子确实是根据光源形成了相对应方向的影子。

但是分帧仔细分析视频后, 发现该功能在强光源的状态下效果才不错,在散漫光源的情况下就一般般了。个人估计:是因为使用的匹配算法的原因。这样,我们就要回到刚才卖关子的ARCore第一个核心功能——姿态估计上,进行具体分析:

传统的特征匹配方法只计算关键点和描述,几十万像素的图像只用了几百个特征点,屏蔽了大部分可能有用的信息,更别说对灰度的估计了。所以,ARCore很有可能是使用了直接法来做相机位姿估计(对直接法感兴趣的同学可以去看看LSD, SVO, DSO等解决方案)。

简单来说,直接法直接使用的是整张图片的像素信息,通过像素亮度来进行运动轨迹的估计。这样的好处是速度很快,直接跳过计算关键点与描述子的步骤。同时在有些缺失特征点的环境下,只要环境中有明暗变化,也能工作,如此大大的避免了跟丢的情况。

直接法的数学推导就不详述了,但是该方案是基于灰度不变的强假设。换句话说, 就是同一空间的像素灰度值,在每张图像上都是不变的。这样就对光源的强弱及位置变化要求比较高,同时相机的自动曝光功能也需要关闭,使得图像不会整体变亮或者变暗。(这一点在外媒TheVerge的上手测试中有体现)ARCore的所谓光源感知功能估计就是基于像素灰度变化的计算。这也就是为什么不同的光源强度下,形成的影子的方向效果有好有差。谷歌果然聪明,在位姿估计的同时顺水推舟地发布一个光源感知功能,一石二鸟!形象一下子就盖过了ARKit。

由于直接法完全依靠像素梯度优化来估计相机位姿,作为Ceres(谷歌推出的SLAM闭环检测算法)的东家,这点对于谷歌来说并不是什么难处。另外一个ARCore使用直接法的例证就是点云。

3

和ARKit相比如何?

ARCore的SDK里是有点云功能的——由于Unity3D的Demo存在Bug,无法看到具体形成的点云是半稠密还是稠密的。但无论是半稠密还是稠密点云的构建,这都是特征法无法实现的。个人估计是半稠密的点云。如果ARCore在没有GPU CUDA加速的情况下真构建了稠密点云,只能膜拜Google大法了。

相比之下,ARCore能够实现的光源感知和点云功能,ARkit实现不了——如果ARKit是Metaio(苹果之前收购的德国公司)做的话,采用特征法的可能性大,这样就无法实现光源感知,点云理论上是能构建,但只能是稀疏的,基本上就是一堆点,看不出什么。至于ARCore整体的工程是SLAM还是VIO,个人的偏向还是VIO更有可能。就如ARKit一样,使用的场景更偏向于手机端,在场景不大的情况下,VIO作为定位方案已经绰绰有余,而且更加节省计算资源。

无论如何,ARCore推出,补全了安卓市场在AR上的空白。基于安卓系统的市场占有率,苹果还敢说自己是最大的AR平台吗?

本文来源: http://36kr.com/p/5090602.html

-

无人驾驶公司“智行者”无人驾驶扫路机在北京某园区正式落地运营发布在 行业动态

蜗小白无人驾驶扫路机共享了此前积累的“蜗必达”AVOS系统测试数据,因此可以快速部署。

9月11日,北京智行者科技有联合百度Apollo 平台、烟台海德在北京某园区进行了无人驾驶扫路机-蜗小白的落地运营。其中无人驾驶扫路机-蜗小白隶属智行者低速无人驾驶“蜗Ω”系列,是无人驾驶作业车的一种。

由左至右依次:百度Apollo运营及生态负责人张辉、烟台海德北京总经理李雪、智行者CEO张德兆蜗小白由烟台海德专用汽车有限公司(提供扫路机平台)、百度Apollo平台(提供高精度地图和定位技术)、智行者(提供无人驾驶整体解决方案)合作推出。蜗小白可以实现园区内自动避障、自主循迹、定点起停、自主扫地等智能功能,并通过WEB端,展示了无人驾驶扫路机全局地图及行驶路径,操作人员在值班室可对无人驾驶扫路机进行安全监控。

在无人驾驶解决方案方面,蜗小白采用了百度Apollo平台提供的高精地图和定位技术。百度高精地图研发工作于2013年底启动,目的是攻克中国复杂道路环境,让无人驾驶车辆可以在中国道路上自由行驶。百度高精地图结合Simultaneous localization and mapping (SLAM)、深度学习、图像处理、计算几何等多种处理技术进行加工及制作,涵盖道路、车道线、交通标志、地面标志、红绿灯、护栏等丰富的道路信息,数据精度达到厘米级别。在这个园区类似的场景中,林荫道路非常普遍,传统的RTK定位技术由于GPS信号弱以及多径效应,无法满足稳定的高精度定位要求,而百度的定位技术可在城市高楼密集市中心、林荫路、隧道、地库等极具挑战的弱/无GPS场景下达到厘米级定位。

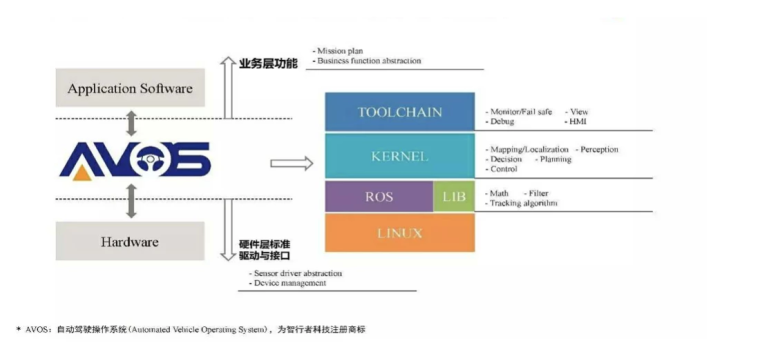

其中一个值得关注的地方是,蜗小白由智行者提供无人驾驶整体解决方案,并搭载智行者自主研发的无人驾驶操作系统AVOS,该系统搭载多传感器自适应融合算法、环境认知算法、路径规划算法以及车辆控制算法,采用算法层与业务层剥离的策略,底层是通用型的算法平台,能满足智能驾驶的各种应用需求。

智行者自主研发的AVOS系统这不是智行者第一次涉足低速无人车领域,早在今年6月份智行者发布了蜗必达-无人配送物流车,蜗小白无人驾驶扫路机共享了此前积累的“蜗必达”AVOS系统测试数据,在短时间内智行者开发完成无人驾驶扫路机,这也是由于AVOS系统具有普适性,可移植性较强。

本文来源:http://36kr.com/p/5092575.html